Apple kertoi viime viikon loppupuolella uusista lasten turvallisuuden parantamiseen tähtäävistä ominaisuuksista laitteidensa käyttöjärjestelmissä ja palveluissaan. Ja sen jälkeen kohu oli valmis, sillä monet näkevät Applen ottaneen yksityisyyttä peruuttamattomalla tavalla heikentävän askeleen.

Vain Applen nyt esittelemistä toiminnoista sinällään jo huomattavasti harvempi on huolissaan, mutta pelkona on vastaavien ratkaisujen käyttö jatkossa laajemmin – ei vain esimerkiksi lapsipornon skannaamiseen, vaan esimerkiksi valtioiden taholta lailla edellytettynä väärinajattelijoiden jahtaamiseen.

Mutta Applen esittelemään uuteen kuvia tarkistavaan toimintoon liittyy myös merkittävä väärinkäsitys.

MAINOS (ARTIKKELI JATKUU ALLA)

Eri uusia avauksia lasten turvallisuuden parantamiseksi Apple esitteli kolme kappaletta:

- iCloud-pilvipalveluun tallennettavien kuvien tarkistus lapsipornon ja muun lasten seksuaaliseksi hyväksikäytöksi määritellyn materiaalin osalta

- Huomautukset Viestit-sovelluksella lasten lähetettäessä tai vastaanottaessa seksuaalissävytteisiä kuvia

- Ohjeistusta Sirissä ja hakutoiminnossa esimerkiksi lasten hyväksikäytöstä raportointiin sekä huomautukset tehtäessä lasten seksuaalissävytteiseen materiaaliin liittyviä hakuja

Liikkeelle lähtenyt väärinkäsitys liittyy näistä ensimmäiseen, eli iCloudiin tallennettavien kuvien tarkistamiseen, joka on myös ominaisuuksista ollut se, jonka suhteen yksityisyysvaikutuksista on oltu eniten huolissaan.

Moni tuntuu ajattelevan, että kyse iCloudiin tallennettavien kuvien tarkistuksessa olisi tekoälytoiminnosta, joka tarkkailisi Applen iOS- tai iPadOS-laitteeseen tallennettuja kuvia, tunnistaisi niistä asioita ja hälyttäisi sitten Applelle, jos kuvissa havaittaisiin liian rohkeaa kuvamateriaalia lapsista. Ajatuksena taustalla lienee, että esimerkiksi kuvien ottaminen omasta lapsesta uimassa voisi johtaa tällaiseen liputukseen.

MAINOS (ARTIKKELI JATKUU ALLA)

Tästä ei toiminnossa kuitenkaan ole kyse.

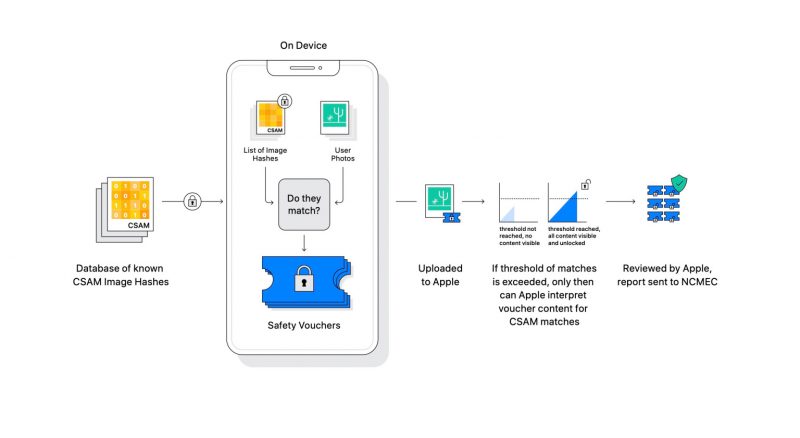

Aluksi vain Yhdysvalloissa käytössä oleva iCloudiin tallennettavien kuvien tarkistaminen ei hyödynnä tekoälyyn perustuvaa kuvan sisällön kuvailevaa tunnistusta, vaan sen sijaan siinä kuvista neuralMatch-algoritmilla muodostettavia tunnisteita – eli käytännössä merkkijonoja – verrataan laitteeseen ladattavaan Yhdysvaltojen kansallisen kadonneiden ja hyväksikäytettyjen lasten keskuksen (NCMEC, National Center for Missing and Exploited Children) ylläpitämään CSAM-tietokantaan tunnisteita kuvista, jotka on määritelty lasten seksuaaliseksi hyväksikäytöksi.

iCloud-tarkistustoiminto ei siis kuvaa skannaamalla tunnista kuvista niiden sisältämiä asioita, vaan se vain vertaa kuvista algoritmilla muodostettuja tunnisteita jo tiedossa olevien, eli jostakin löydettyjen tai jossakin jaettujen, lasten seksuaaliseksi hyväksikäytöksi määriteltyjen kuvien (CSAM) tunnisteisiin. Jos nämä täsmäävät riittävällä tarkkuudella, eli laitteesta näyttäisi löytyvän jo entuudestaan lasten seksuaaliseksi hyväksikäytöksi määritelty kuva, kirjaa toiminto tästä tiedon ylös.

Applen sivuillaan kuvailemalla tavalla toiminto on vielä toteutettu niin, että Apple ei saa tietää mahdollisista täsmäävistä kuvista mitään ennen kuin tietty määritelty vähimmäisraja lasten seksuaaliseksi hyväksikäytöksi määriteltyä materiaalia saavutetaan. Käytännössä siis vaikkapa yksittäinen kuva ei vielä aiheuta Applelle näkyvää ilmoitusta. Vasta, kun raja ylittyy, käyttäjätilistä ilmoitetaan Applelle ja se saa tiedon CSAM-tietokantaan nähden syntyneistä osumista, jonka jälkeen se manuaalisesti vahvistaa osumat, estää käyttäjätilin käytön ja raportoi asian NCMEC-keskukselle.

MAINOS (ARTIKKELI JATKUU ALLA)

Applen mukaan tarkistusraja on asetettu erittäin korkealle tarkkuudelle, mikä varmistaa, että on olemassa alle yhden suhde biljoonaan mahdollisuus virheellisestä käyttäjätilin liputtamisesta Applen henkilöstön tarkistettavaksi.

Kuvien tarkistustoiminto liittyy Applen iCloud-pilvipalveluun, eikä tarkistusta suoriteta, mikäli iCloud-kuvakirjaston on kytkenyt pois käytöstä. Itse tarkistus, eli kuvien vertaus CSAM-tunnisteisiin, suoritetaan kuitenkin käyttäjän laitteessa ennen kuvien lähettämistä iCloudiin eikä Applen pilvipalvelussa. Apple on perinteisesti pitänyt esillä, kuinka laitteessa tapahtuvat toiminnot ovat yksityisempiä kuin pilvipalvelussa suoritetut toiminnot. Tällä kertaa tämä on kuitenkin myös kostautunut Applelle, sillä sen on nyt loukkaavan yksityisyyttä uudella toiminnollaan. Mutta jos ei halua kuviaan tarkastettavan, voi vain lopettaa iCloudin käytön niiden osalta.

Applen toiminta CSAM-materiaalin suhteen ei ole poikkeuksellista, sillä monet muutkin palvelut Facebookista Googleen ovat jo vuosien ajan tarkistaneet palveluissaan siirrettäviä kuvia CSAM-tunnisteita vastaan.

Applen osalta kohu on nyt syntynyt osin väärinkäsitysten vuoksi.

MAINOS (ARTIKKELI JATKUU ALLA)

Sinällään Applen tekemät päätökset toteutuksen yksityiskohdissa – kuten kuvien tarkistamisessa laitteessa pilvipalvelun sijaan, vaikka tarkistus vain iCloudiiin liittyykin, ovat voineet kiihdyttää kohua.

Lisäksi tilannetta sekoittaa se, että samalla Apple julkisti myös osaksi Viestit-sovellustaan edellä listatulla tavalla uuden toiminnon, joka todella skannaa kuvia tekoälyn avulla niiden sisällön perusteella alkaen iOS 15:stä, iPadOS 15:stä ja macOS Montereysta, jotka julkaistaan tänä syksynä.

Jos lapsi vastaanottaa tai lähettää tekoälyn seksuaalissävytteiseksi määrittelemää materiaalia, tulee tästä ensin varoitus ennen materiaalin näyttämistä, minkä lisäksi tapahtuneesta lähtee ilmoitus vanhemmille. Vastaavasti lapsen lähettäessä seksuaalissävytteistä materiaalia, voi Viestit-sovellus varoittaa ja ilmoittaa asiasta vanhemmille.

Uusi toiminto on tulossa käyttöön osana Applen Perhajako-ominaisuuksia, jotka tarjoavat vanhemmille muitakin hallintamahdollisuuksia lastensa laitteisiin.

Viestit-sovelluksen uusi toiminto on Applen mukaan suunniteltu niin, ettei Apple pääse näkemään viestejä. Tältä osin yksityisyyteen ei siis ole vaikutuksia mitä tulee tietojen paljastumiseen Applelle. Eikä toiminto lähetä lasten Viestit-sovelluksen käyttöön perustuen ilmoituksia muille kuin Perhejako-toiminnossa määritellyille vanhemmille.

Lisäksi moni unohtaa, että edellä laajemmin käsitelty iCloud-kuvien tarkastus koskee toistaiseksi vain Yhdysvaltoja iOS ja iPadOS 15 -käyttöjärjestelmäversioista alkaen ja Apple on kertonut toiminnon laajenevan jatkossa maa kerrallaan niin, että se sopii paikalliseen lainsäädäntöön. Apple-laitteiden käyttäjiä Euroopassa, mukaan lukien Suomessa, toiminto ei siis myöskään toistaiseksi kosketa lainkaan.

Mainos: Noin 1 600 000 tuotteen hintavertailu ja hintaseuranta - katso Hinta.fistä mistä saat halvimmalla

Salasana hukassa?

Etkö ole vielä rekisteröitynyt? Rekisteröidy tästä »